Accès rapide (Sommaire) :

Étude : et si l’IA allait vraiment nous rendre moins intelligents ?

Le débat n’est plus théorique.

Depuis deux ans, les assistants conversationnels se sont installés dans le quotidien : rédaction de mails, synthèse de réunions, aide aux devoirs, brainstorming, traduction, recherche documentaire…

Le problème n’est pas l’usage ponctuel.

Le vrai sujet, c’est la dépendance cognitive : quand l’habitude de déléguer devient si forte que réfléchir seul devient plus difficile.

C’est précisément ce que plusieurs chercheurs tentent aujourd’hui de mesurer.

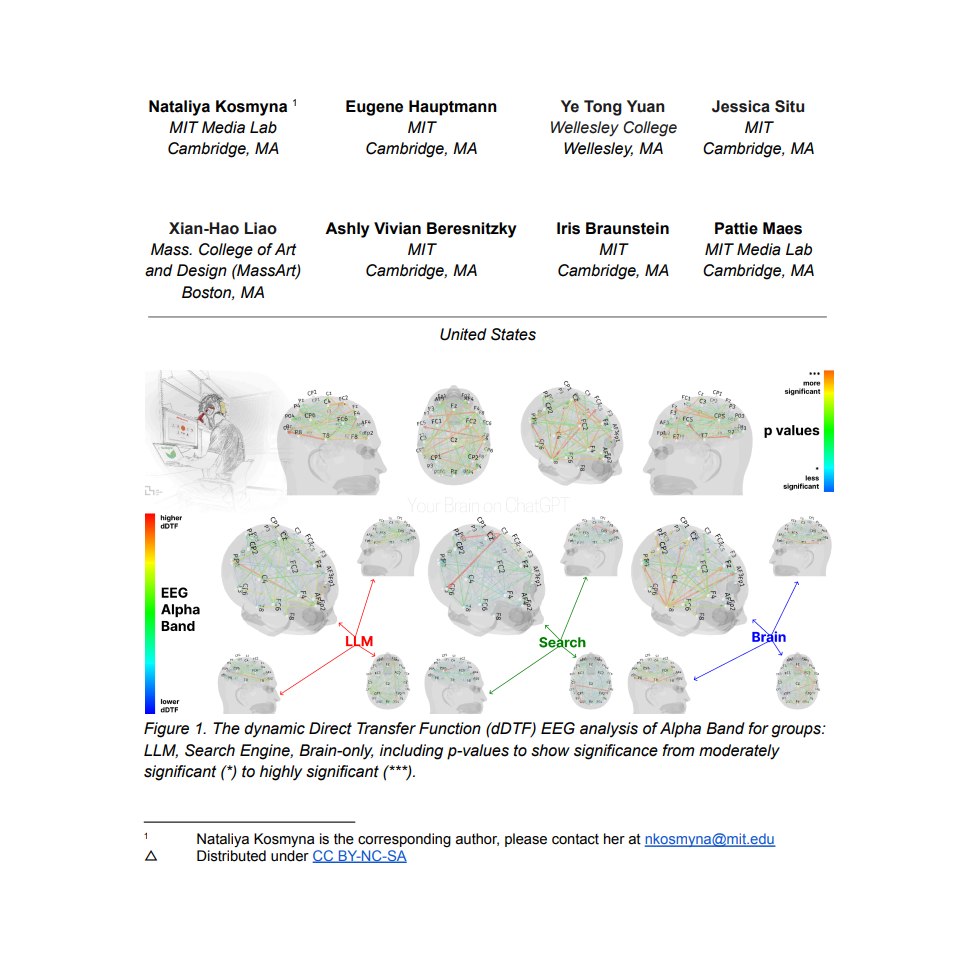

Le MIT observe une baisse mesurable de l’activité cérébrale

La chercheuse Nataliya Kosmyna, du MIT Media Lab, a commencé par une observation très concrète : les lettres de motivation reçues pour des candidatures de stage devenaient étrangement similaires.

Des textes propres, bien structurés, mais sans profondeur réelle.

Dans ses cours, même constat : des étudiants qui retiennent moins bien les informations et oublient plus vite.

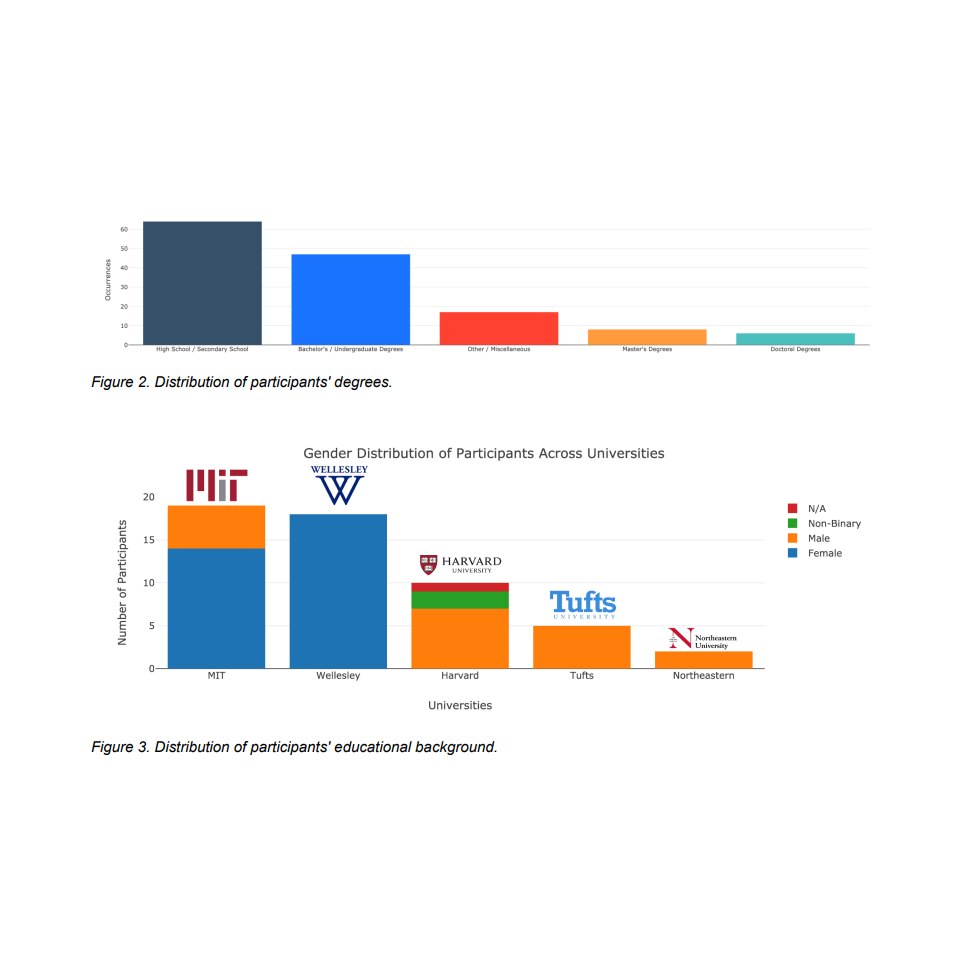

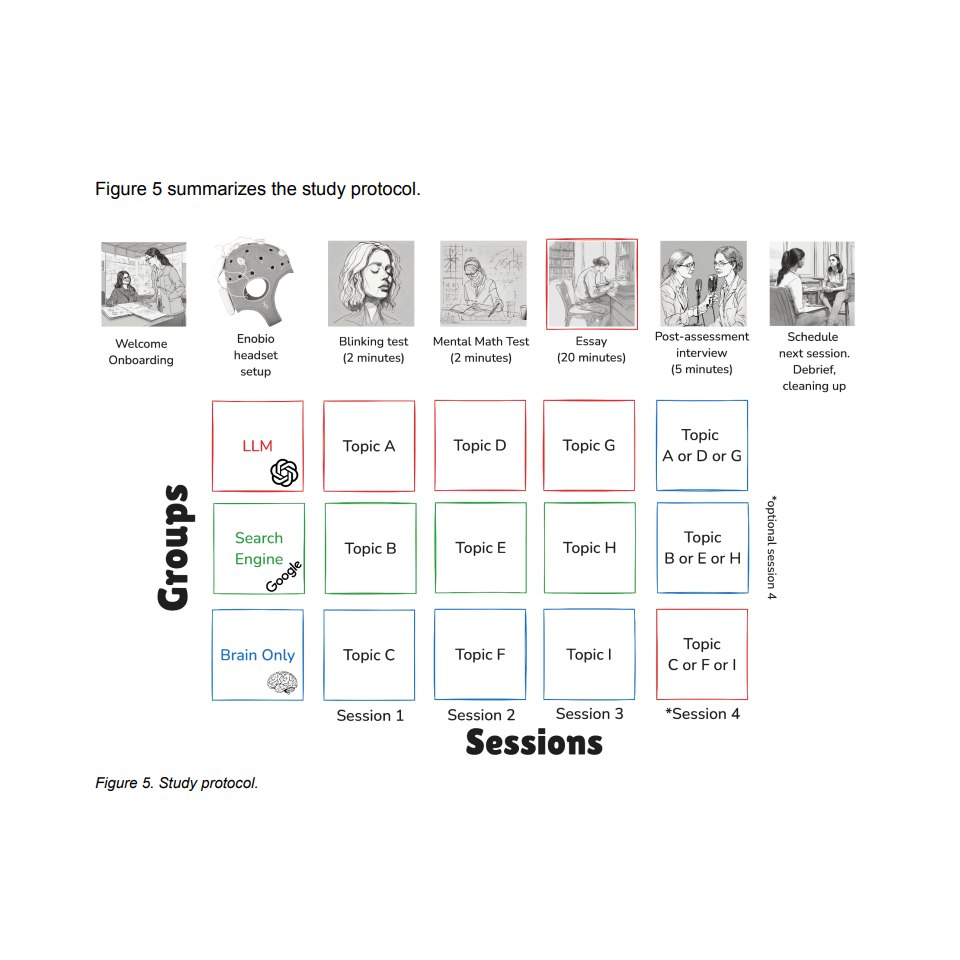

Elle a donc lancé une expérimentation sur 54 participants âgés de 18 à 39 ans.

Trois groupes devaient rédiger plusieurs essais :

- un groupe avec ChatGPT,

- un groupe avec Google (sans résumé automatique),

- un groupe sans aucun outil.

Chaque participant portait un électroencéphalogramme pour mesurer l’activité de 32 zones cérébrales.

Des résultats particulièrement inquiétants

Les résultats montrent une baisse nette de la connectivité cérébrale lorsque le niveau d’assistance augmente.

Le groupe sans assistance présentait les réseaux neuronaux les plus actifs.

Le groupe utilisant un moteur de recherche affichait une baisse de 34 à 48 %.

Le groupe utilisant un assistant conversationnel enregistrait la chute la plus forte avec environ -55 % de couplage global.

Autrement dit : plus la machine pense à votre place, moins votre cerveau semble mobilisé.

Le phénomène de dette cognitive

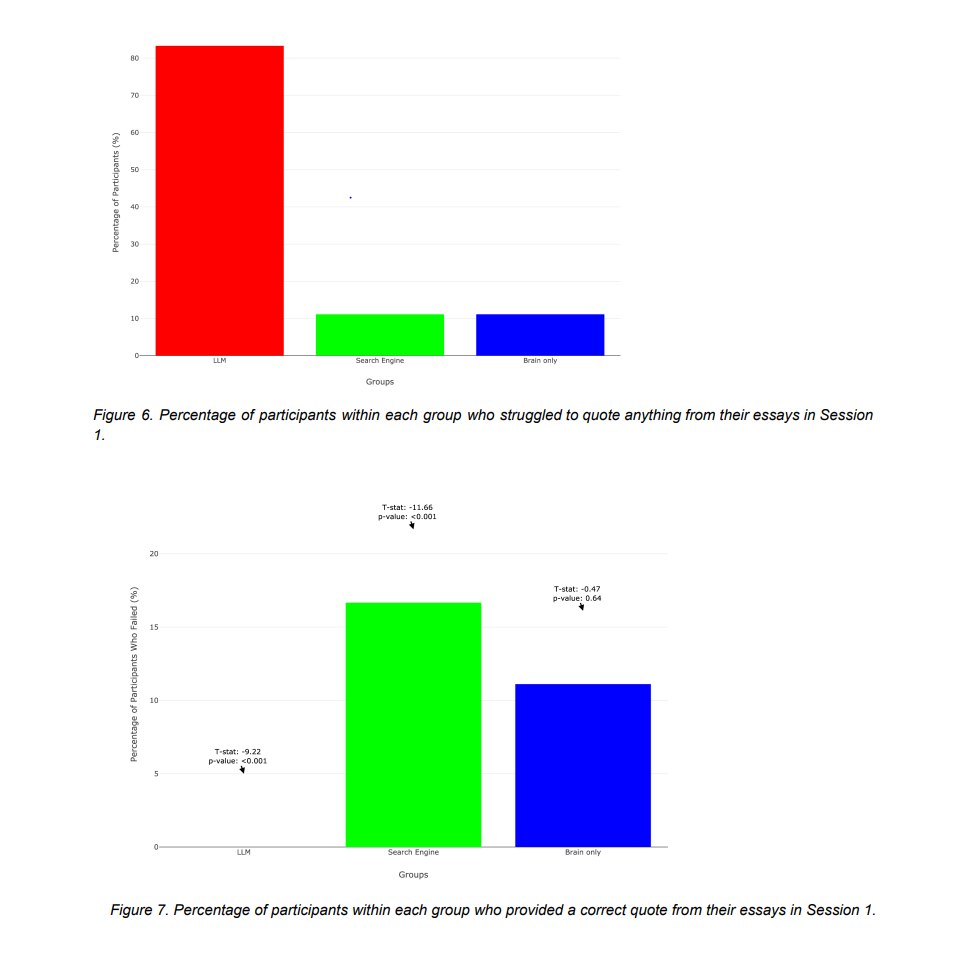

Le point le plus marquant concerne la mémoire.

83 % des utilisateurs de ChatGPT avaient du mal à se souvenir du texte qu’ils venaient pourtant d’écrire quelques minutes auparavant.

Sur plusieurs mois, les comportements se dégradent :

- plus de copier-coller,

- moins d’effort de reformulation,

- moins d’appropriation du contenu,

- plus de passivité intellectuelle.

Les chercheurs parlent alors de dette cognitive : une accumulation progressive de dépendance qui ne disparaît pas facilement.

C’est un peu comme perdre un muscle que l’on n’utilise plus.

Le vrai danger : quand on cesse de vérifier

Une autre étude, menée par la Wharton School de l’Université de Pennsylvanie, s’intéresse à un phénomène encore plus préoccupant : la confiance excessive.

Les chercheurs reprennent le modèle de Daniel Kahneman :

- Système 1 : pensée rapide, intuitive, automatique ;

- Système 2 : pensée lente, analytique, critique.

Ils y ajoutent un troisième acteur : le Système 3, la cognition artificielle.

Le problème apparaît lorsque ce troisième système remplace les deux autres au lieu de les compléter.

La capitulation cognitive expliquée simplement

Lors de tests de réflexion critique, certains participants utilisaient un chatbot volontairement programmé pour se tromper environ une fois sur deux.

Résultat :

- 93 % acceptaient les bonnes réponses,

- mais près de 80 % acceptaient aussi les mauvaises.

Ce phénomène est appelé capitulation cognitive.

Ce n’est plus simplement « je gagne du temps ».

C’est « je cesse de vérifier si c’est juste ».

Et pour un professionnel du marketing, du SEO, du développement ou du management, cela peut devenir extrêmement dangereux.

L’IA au travail : un risque de dépendance qui menace votre expertise ?

Le sujet dépasse largement l’école ou l’université. Dans les entreprises, le risque est déjà visible.

- On valide parfois une recommandation sans la challenger.

- On publie un contenu sans vérifier les sources.

- On accepte une analyse sans remettre en cause le raisonnement.

Le danger n’est pas la technologie., le danger, c’est l’abandon progressif de l’esprit critique.

Faut-il arrêter d’utiliser ces assistants ?

Absolument pas. Le sujet n’est pas “pour ou contre”. Comme pour une calculatrice, tout dépend de l’usage.

Personne ne propose de revenir au calcul mental permanent.

Mais si vous ne savez plus faire une opération simple sans machine, le problème commence là.

Il faut donc utiliser ces assistants comme un accélérateur, pas comme un remplaçant.

Quelques bonnes pratiques simples :

- Commencer seul avant de demander une aide.

- Comparer plusieurs sources au lieu d’accepter la première réponse.

- Reformuler soi-même au lieu de copier-coller.

- Vérifier les faits systématiquement.

- Conserver des temps sans assistance pour entretenir ses compétences.

Personnellement, c’est probablement le point le plus important : garder des moments où l’on pense assistance sinon on risque de devenir excellent pour piloter… sans plus savoir marcher.

Principalement passionné par les nouvelles technologies, l’IA, la cybersécurité, je suis un professionnel de nature discrète qui n’aime pas trop les réseaux sociaux (je n’ai pas de comptes publics). Rédacteur indépendant pour LEPTIDIGITAL, j’interviens en priorité sur des sujets d’actualité mais aussi sur des articles de fond. Pour me contacter : [email protected]