Accès rapide (Sommaire) :

TranslateGemma, une nouvelle brique dans la stratégie open source de Google

Avec TranslateGemma, Google lance une suite complète de modèles ouverts, conçus spécifiquement pour la traduction, et bâtis sur l’architecture Gemma 3, elle-même dérivée des modèles Gemini les plus avancés.

L’objectif affiché est clair : démocratiser la traduction de qualité professionnelle, sans dépendre d’infrastructures lourdes ou de services fermés.

Là où de nombreux systèmes restent réservés au cloud ou à des API propriétaires, TranslateGemma vise une diffusion beaucoup plus large, du mobile jusqu’aux GPU haut de gamme.

Trois tailles de modèles pour des usages très différents

Google propose TranslateGemma en trois déclinaisons :

- 4B paramètres, pensé pour les environnements contraints (mobile, edge computing).

- 12B paramètres, capable de tourner sur un ordinateur portable grand public.

- 27B paramètres, orienté vers la fidélité maximale, déployable sur une seule carte GPU H100 ou TPU.

Cette répartition n’est pas anodine : elle permet à des profils très différents, chercheurs, développeurs indépendants, équipes produit, de choisir un compromis précis entre qualité, coût et latence.

TranslateGemma : comment un modèle plus petit peut surpasser d’autres modèles plus conséquents ?

Le point le plus marquant de TranslateGemma ne tient pas uniquement à la qualité de traduction, mais à son rendement.

Google met en avant un résultat clé : le modèle 12B dépasse, sur certains benchmarks, les performances d’un modèle Gemma 3 deux fois plus grand.

Cela signifie qu’il est possible d’obtenir des traductions plus fiables avec moins de paramètres, moins de calcul et moins de latence.

Pour les professionnels, c’est ce qui rend envisageable un déploiement local, en temps réel, à grande échelle.

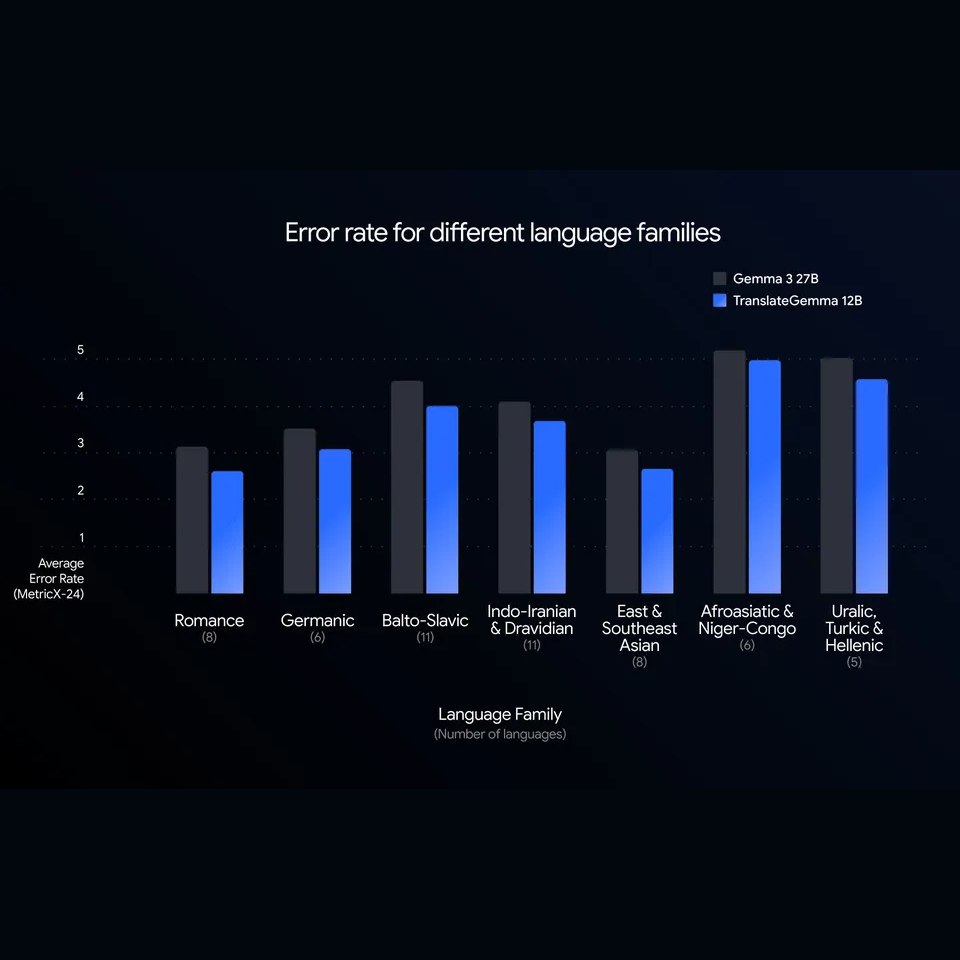

Ce que montrent les évaluations publiées

Google s’appuie notamment sur le benchmark WMT24++, qui couvre 55 langues, incluant des langues très dotées en données, mais aussi des langues dites « faiblement dotées ».

Sur cet ensemble, TranslateGemma affiche :

- une baisse systématique du taux d’erreur par rapport aux modèles Gemma standards,

- des gains visibles sur plusieurs familles linguistiques,

- une stabilité accrue sur les langues moins représentées.

Autrement dit, l’amélioration ne se limite pas aux langues les plus communes : c’est un point crucial pour les usages réellement internationaux.

Comment TranslateGemma a été entraîné ?

Google décrit un processus en deux grandes étapes, pensé pour transférer le « savoir-faire » de modèles imposants vers des architectures plus compactes.

Une première phase d’apprentissage supervisé

Les modèles Gemma 3 ont d’abord été entraînés sur de vastes corpus de textes bilingues.

Ces données mélangent :

- des traductions humaines validées,

- des traductions synthétiques de haute qualité produites par des modèles Gemini.

Cette approche permet de couvrir un grand nombre de langues, y compris celles pour lesquelles les données humaines sont rares.

Un raffinement par apprentissage par renforcement

Dans un second temps, Google a utilisé des mécanismes d’évaluation automatique avancés pour pousser les modèles vers des traductions plus naturelles, plus contextuelles et plus fidèles au sens.

L’enjeu n’est pas seulement de traduire « correctement », mais de produire un texte qui sonne juste dans la langue cible, un point souvent négligé dans les modèles plus anciens.

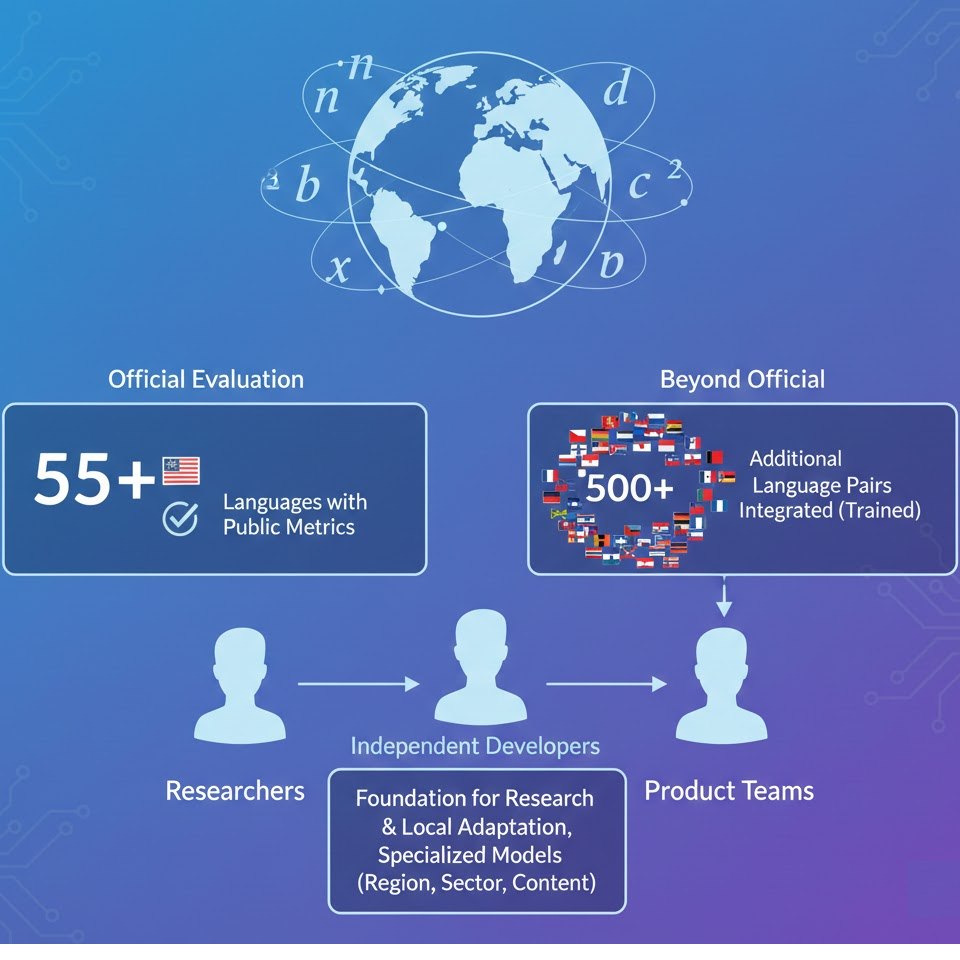

Une couverture linguistique pensée pour durer

TranslateGemma est officiellement évalué sur 55 langues, mais Google va plus loin : près de 500 paires linguistiques supplémentaires ont été intégrées lors de l’entraînement.

Toutes ne disposent pas encore de métriques publiques, mais l’intention est claire : faire de TranslateGemma une base de travail pour la recherche et l’adaptation locale, notamment pour les langues peu couvertes par les outils commerciaux.

Pour les équipes techniques, cela ouvre la porte à des modèles spécialisés par région, par secteur ou par type de contenu, sans repartir de zéro.

Des capacités multimodales qui dépassent la simple traduction de texte

Autre point intéressant : TranslateGemma hérite des capacités multimodales de Gemma 3.

Lors de tests sur la traduction de texte présent dans des images, les améliorations obtenues sur le texte pur se répercutent positivement.

Sans entraînement spécifique supplémentaire, le modèle se montre plus fiable pour interpréter et traduire du contenu visuel, ce qui laisse entrevoir des usages concrets dans la documentation, l’e-commerce ou le support international.

Comment accéder à TranslateGemma ?

TranslateGemma est déjà disponible et exploitable :

- les modèles sont disponibles en téléchargement libre ici,

- un rapport technique détaille les choix et limites actuelles,

- des environnements comme Kaggle, Hugging Face ou Vertex AI permettent de les tester rapidement.

Pour aller plus loin, vous pouvez également consulter cette ressource.

Principalement passionné par les nouvelles technologies, l’IA, la cybersécurité, je suis un professionnel de nature discrète qui n’aime pas trop les réseaux sociaux (je n’ai pas de comptes publics). Rédacteur indépendant pour LEPTIDIGITAL, j’interviens en priorité sur des sujets d’actualité mais aussi sur des articles de fond. Pour me contacter : [email protected]